Web Scraping vs API Pronta: Qual a Melhor Forma de Extrair Dados da Web em 2026?

Quer testar? Acesse o dashboard e ganhe 100 créditos grátis para começar.

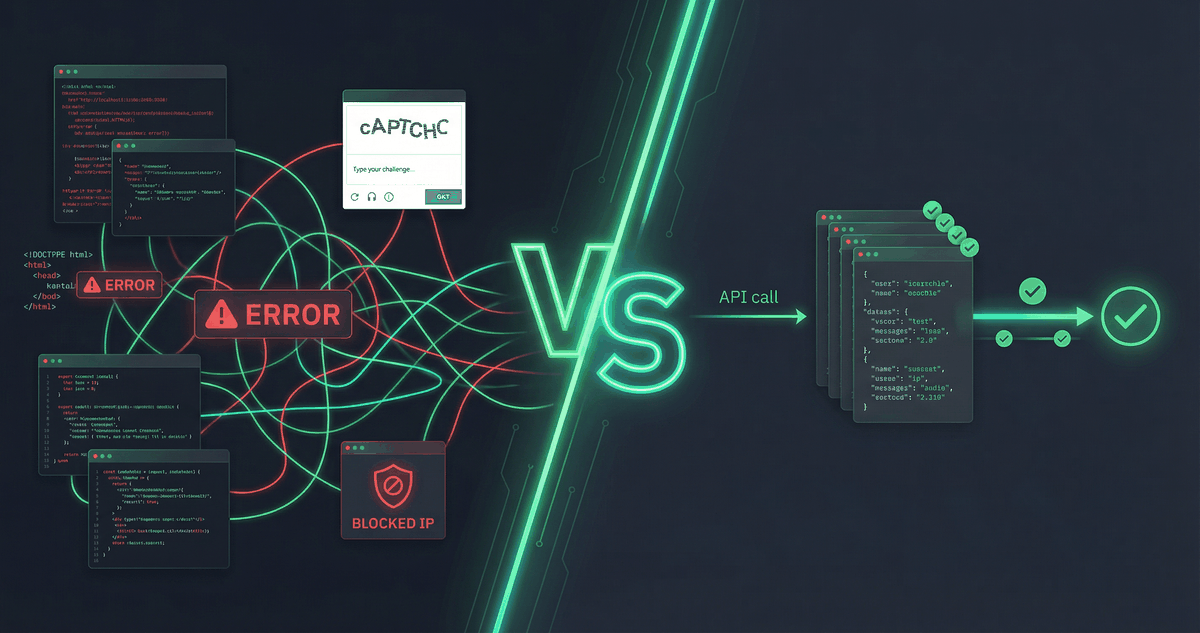

Ir para o DashboardSe você já tentou extrair dados da web, sabe como a história costuma terminar: um script que funciona na segunda e quebra na sexta. CAPTCHAs, mudanças de layout, bloqueio de IP — a lista de dores de cabeça é longa.

Neste post, comparamos as duas abordagens mais comuns de extração de dados em 2026: o caminho “faça você mesmo” com ferramentas como Puppeteer e BeautifulSoup, e o caminho “plug and play” com uma API pronta como a GeckoAPI. O objetivo é te ajudar a decidir qual faz mais sentido para o seu caso — e quanto tempo (e dinheiro) cada abordagem realmente custa.

O cenário atual da extração de dados

O volume de dados públicos disponíveis na web nunca foi tão grande. Empresas usam esses dados para:

- Monitorar preços de concorrentes em marketplaces como Mercado Livre, Amazon e Shopee

- Enriquecer catálogos com informações detalhadas de produtos

- Alimentar modelos de IA e dashboards de BI com dados atualizados

- Automatizar processos que antes dependiam de copiar e colar manualmente

O problema não é a falta de dados — é como obtê-los de forma confiável e escalável.

Abordagem 1: Web scraping “faça você mesmo”

A abordagem clássica de web scraping envolve escrever scripts que navegam páginas, parseiam HTML e extraem os dados que você precisa. As ferramentas mais usadas em 2026 são:

Ferramentas populares de web scraping

| Ferramenta | Linguagem | Melhor para |

|---|---|---|

| BeautifulSoup | Python | Parsing de HTML estático |

| Puppeteer | Node.js | Sites com renderização JS |

| Playwright | Python/Node/C# | Automação cross-browser |

| Scrapy | Python | Crawling em escala |

| Selenium | Multi | Automação de browser legado |

Exemplo: scraping básico com Python

import requests

from bs4 import BeautifulSoup

url = "https://www.exemplo.com.br/produto/12345"

headers = {"User-Agent": "Mozilla/5.0 (compatible; MeuBot/1.0)"}

response = requests.get(url, headers=headers)

soup = BeautifulSoup(response.text, "html.parser")

titulo = soup.select_one("h1.product-title").text.strip()

preco = soup.select_one("span.price").text.strip()

print(f"{titulo}: {preco}")

Parece simples, certo? Mas na prática, esse script vai quebrar quando:

- O site mudar a classe CSS de

product-titleparapdp-title - O preço carregar via JavaScript (e o

requestsnão executa JS) - O site detectar seu User-Agent e retornar um CAPTCHA

- Seu IP for bloqueado após poucas dezenas de requisições

O custo real do web scraping manual

O que parece ser “de graça” na verdade envolve custos significativos:

- Desenvolvimento inicial: 2-4 semanas para um scraper robusto por site

- Manutenção contínua: cada mudança de layout quebra seu código

- Infraestrutura de proxies: R$ 200-2.000/mês para proxies residenciais de qualidade

- Resolução de CAPTCHAs: serviços como 2Captcha custam por resolução

- Tempo de debug: horas perdidas investigando por que o scraper parou

Para evitar bloqueio de IP, você precisa implementar:

- Rotação de proxies (residenciais, datacenter, mobile)

- Rotação de User-Agent e fingerprint de navegador

- Delays aleatórios entre requisições

- Lógica de retry com backoff exponencial

- Resolução automática de CAPTCHAs

E mesmo com tudo isso, não há garantia de estabilidade. Sites grandes atualizam seus mecanismos anti-bot constantemente.

Abordagem 2: API pronta de extração de dados

A alternativa é usar uma API que já resolve toda a complexidade de extração por debaixo dos panos. Você envia uma URL, recebe um JSON estruturado.

Como funciona na prática

Com a GeckoAPI, a extração se resume a uma chamada HTTP:

curl -X POST \

-H "Authorization: Bearer SUA_CHAVE" \

-H "Content-Type: application/json" \

-d '{"url":"https://www.mercadolivre.com.br/produto-exemplo/p/MLB123","target":"mercadolivre.com.br","type":"pdp"}' \

https://api.geckoapi.com.br/v1/extract

A resposta vem padronizada:

{

"executionId": "abc-123-def",

"data": {

"title": "Notebook Gamer 16GB RAM SSD 512GB",

"price": 4299.90,

"seller": "TechStore Oficial",

"rating": 4.7,

"reviewCount": 234,

"images": ["https://..."],

"attributes": { "RAM": "16GB", "Armazenamento": "512GB SSD" }

}

}

O mesmo padrão funciona para Magazine Luiza, OLX, Booking, iFood, Webmotors e outras fontes — mesma autenticação, mesmo formato JSON.

Exemplo: consumindo a API com Python

import requests

API_KEY = "SUA_CHAVE"

API_URL = "https://api.geckoapi.com.br/v1/extract"

payload = {

"url": "https://www.amazon.com.br/dp/B09V3KXJPB",

"target": "amazon.com.br",

"type": "pdp"

}

response = requests.post(

API_URL,

json=payload,

headers={"Authorization": f"Bearer {API_KEY}"}

)

data = response.json()["data"]

print(f"{data['title']}: R$ {data['price']}")

Sem proxies, sem parsing de HTML, sem CAPTCHAs. E se o site mudar o layout? A GeckoAPI cuida da adaptação — seu código não precisa mudar.

Comparação lado a lado

Aqui está o que realmente importa na hora de decidir entre web scraping manual e uma API pronta:

| Critério | Web Scraping Manual | API Pronta (GeckoAPI) |

|---|---|---|

| Tempo de setup | 2-4 semanas por site | Minutos (uma chamada HTTP) |

| Manutenção | Constante (a cada mudança de layout) | Zero (a API se adapta) |

| Bloqueio de IP | Frequente, exige proxies | Não é problema seu |

| CAPTCHAs | Precisa resolver manualmente | Resolvido internamente |

| Formato dos dados | Varia por site (HTML → parse) | JSON padronizado, sempre |

| Custo mensal | R$ 500-5.000+ (infra + dev) | Pay-as-you-go |

| Escalabilidade | Limitada pela infra de proxies | Escala sob demanda |

| Conformidade legal | Responsabilidade 100% sua | Dados públicos, formato padronizado |

Quando o scraping manual ainda faz sentido

Não vamos fingir que API pronta resolve tudo. Web scraping manual ainda é a melhor escolha em alguns cenários:

- Sites muito nichados que nenhuma API cobre (ex.: portal interno de uma prefeitura)

- Necessidade de controle total sobre o fluxo de navegação (login com OAuth, sessões complexas)

- Projetos de pesquisa acadêmica com requisitos de reprodutibilidade muito específicos

- Orçamento zero e muito tempo livre para manutenção

Se o seu caso se encaixa aqui, invista em Playwright (mais moderno que Selenium) e considere serviços como ScraperAPI ou Bright Data para a camada de proxies.

Quando a API pronta é a escolha certa

Para a maioria dos casos de uso comercial, a API pronta ganha por larga margem:

- Monitoramento de preços em marketplaces — múltiplas fontes, mesmo formato

- Enriquecimento de catálogo — dados estruturados sem esforço de parsing

- BI e analytics — dados confiáveis e padronizados para dashboards

- Integração com IA — chatbots e agentes MCP que precisam de dados em tempo real

- MVPs e validação — testar uma ideia sem gastar semanas em infraestrutura

O cálculo é direto: se uma hora do seu time de desenvolvimento custa R$ 100-200, e um scraper leva 80+ horas para ficar robusto, você está gastando R$ 8.000-16.000 antes de extrair o primeiro dado. Com uma API pay-as-you-go, seu custo inicial é próximo de zero.

Integrando com agentes de IA e chatbots

Uma vantagem que APIs prontas têm sobre scrapers é a integração nativa com agentes de IA. Com o protocolo MCP (Model Context Protocol), seu chatbot pode consultar dados em tempo real antes de responder:

{

"mcpServers": {

"geckoapi": {

"url": "https://api.geckoapi.com.br/v1/mcp",

"apiKey": "SUA_CHAVE"

}

}

}

O fluxo fica: Usuário pergunta → Agente MCP → GeckoAPI → Resposta com dados reais. Isso elimina alucinação e aumenta a confiança nas respostas. Veja como funciona na prática com dados do Mercado Livre ou da OLX.

Boas práticas independente da abordagem

Seja qual for o caminho que você escolher, essas práticas valem para qualquer projeto de extração de dados:

-

Cache agressivo — armazene respostas para reduzir custo e latência. Dados que mudam pouco (ex.: atributos de produto) não precisam ser re-extraídos toda hora.

-

Rate limiting — respeite limites, tanto do site-alvo quanto da API que você usa. Isso evita bloqueios e mantém custo previsível.

-

Monitoramento e alertas — saiba quando algo quebrou antes que o seu dashboard fique vazio. Logs estruturados são indispensáveis.

-

LGPD e compliance — não colete dados pessoais sem base legal. Preços de produtos são dados públicos; CPF de vendedores, não.

-

Schema validation — valide o formato dos dados recebidos. Se um campo esperado vier nulo, seu pipeline precisa lidar com isso sem quebrar.

TL;DR — Resumo da decisão

- Precisa de controle total e tem tempo/equipe para manter? → Web scraping manual

- Quer dados estruturados rápido e focar no produto? → API pronta

- Está montando um MVP ou PoC? → API pronta, sem dúvida

- Precisa de múltiplas fontes no mesmo formato? → API pronta com camada de dados padronizada

Quer testar na prática? Acesse dashboard.geckoapi.com.br e comece com 1000 requisições grátis por mês. Em 5 minutos você extrai dados do Mercado Livre, Amazon, iFood e mais — sem proxy, sem CAPTCHA, sem dor de cabeça.

Quer testar?

Acesse o dashboard e ganhe 100 créditos grátis para começar. Sem cartão de crédito.

Criar conta grátis